猎云网注:从渗透到生活的方方面面,再到首次写入工作报告,我们越来越多的看到AI技术身影穿梭其中,

如今的人工智能已经开始渗透我们日常生活的方方面面,无论是政府机构、企业公司、教育学府还是普通人家庭都开始越来越多的看到AI技术身影穿梭其中。

不过所谓人无完人,AI技术目前也远远没有发展到“完美”的阶段,人们在之前的使用中也多次碰到了AI“宕机”的情况。

以下为AI世代整理的过去一段时间AI技术所出现的八个典型失败案例:

1、亚马逊Alexa助手自动帮小孩下单购买玩具

今年早些时候,一名六岁的女孩在跟Echo内置人工智能语音助手Alexa聊天时,意外订下了价值170美元的玩具和一盒重达四磅的饼干。

虽然孩子的妈妈在收到一个不知打哪来的订单确认电话后立刻进行了取消操作,但该订单却已经被处理,且一个跟孩子身高几乎相同的玩偶就在隔天送来了。最后,他们无奈的决定将这一玩偶捐赠给当地儿童医院。

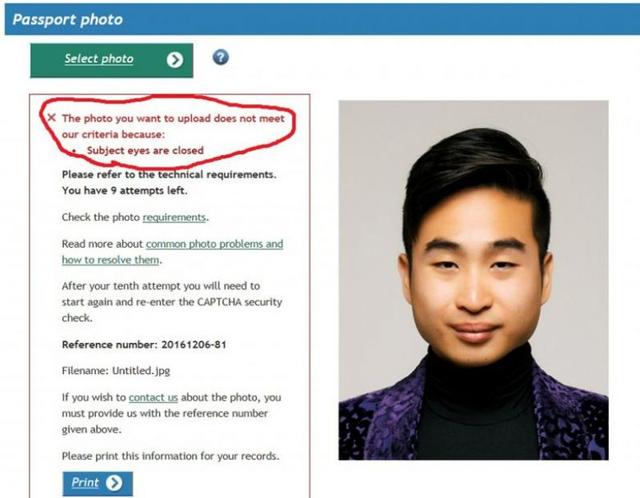

2、图像识别AI出错

一名名为理查德-里(Richard Lee)的亚裔男子在试图网络更新护照的时候被新西兰内务部软件判断为“眼睛闭上,照片审核未通过”。最后,理查德-里只能亲自联系被新西兰内务部,并通过人工审核的方式才成功更新了自己的护照。

3、亚马逊Alexa误听指令向孩子提供成人内容

最近国外网站出现一段视频,在视频中小孩向亚马逊Alexa下达指令:“Alexa,请播放‘Digger digger(一首儿童歌曲)’。”之后,亚马逊个人助手通过算法进行识别,竟然认为孩子想听情色内容。不一会,孩子的父母才意识到发生了什么事,可惜他们已经无法阻止Alexa继续播放声音。

对此,亚马逊新闻发言人表示:“我们之前已经修正过该问题,但Alexa很难完全屏蔽成人内容。目前我们正在加强限制防止类似的事情再次发生,并已经与客户取得联系向他们致歉。”

4、机器人误伤事件

在去年的深圳高交会上,一台名为“小胖”的机器人在没有指令的情况下突然自行打砸展台玻璃,最终导致部分展台破坏。与此同时,该机器人撞向展台玻璃致使玻璃倒地、摔碎,并划伤一名现场观众,致其脚踝被划破流血送医。

5、AI竟也存在人种歧视

在由微软和英伟达支持的“青年实验室“(Youth Laboratories)此前举办了全球第一届AI选美比赛,这一比赛也吸引了来自全球119个国家和地区的六千多人参加。不过,在AI选美比赛的最终结果却让人大失所望,因为在最终脱颖而出的44位选美冠军中,黄色人种和黑色人种分别只有6名和1名,其余的37张面孔都是白种人,这也让人不禁怀疑原来AI也存在人种歧视观念。

6、微软AI机器人Tay发布种族主义言论被微软关停

微软此前曾将设计的“Tay”AI聊天机器人放到了包括Twitter在内的社交网络上,希望“Tay”能够通过社交平台学习应该怎么像青少女一样与别人互动。不过,互联网上充斥着各种各样的人,包括那些希望看到世界大乱的网友。其中,就有一帮人希望Tay能说出类似“希特勒是对的”这样“大逆不道”的话。而且,由于“Tay”在设计上原本就会模仿人类说话,因此微软很快便让“Tay”下线了。

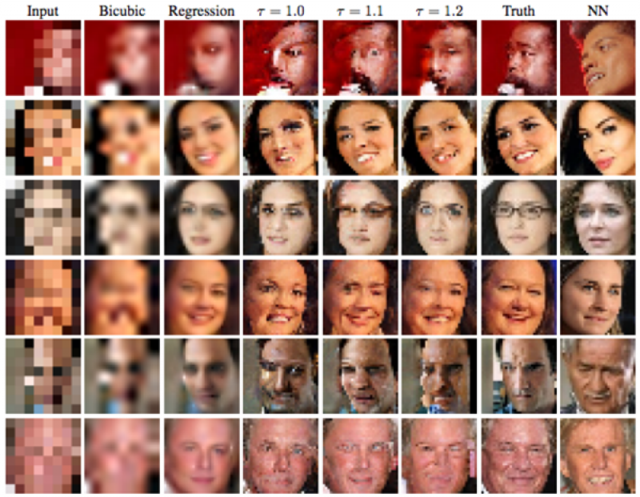

7、谷歌(微博)“还原马赛克”AI技术堪比恐怖图库

谷歌大脑(Google Brain)团队此前开发了一个软件,能利用人工神经网络来填充低分辨率图像细节。也就是说,那些打了马赛克的照片有可能在后期被谷歌成功还原。只不过,在实际使用中我们发现还原马赛克AI技术给出的许多还原后照片都非常恐怖。

8、考试机器人没过大学录取线

日本国立情报学研究所此前推出了一个名为“东大机器人”(Todai Robot Project)的项目,其目标是未来能通过日本顶级学府东京大学的入学考试。但有消息称,自2011年以来“东大机器人项目”就开始攻关日本的大学入学考试,但在过去连续2年的得分均低于东京大学的录取分数线。因此,其开发团队已经在去年11月正式宣布放弃该项目。